Die Führungskräfte der großen KI-Labore sagen es seit Jahren: Künstliche Intelligenz wird Krebs heilen, die Wirtschaft transformieren – und das Klimaproblem lösen. Das klingt nach dem üblichen Silicon-Valley-Hype. Aber was, wenn es genau so kommt? Was, wenn die Technologie tatsächlich kurz davor steht, einen Sprung zu machen, der alles Bisherige in den Schatten stellt?

Dieser Artikel versucht, diese Frage ernst zu nehmen. Nicht optimistisch-naiv, aber auch nicht reflexartig zynisch. Sondern so präzise wie möglich: Was genau steht uns bevor? Und falls tatsächlich eine Intelligenz-Explosion kommt – was kann das konkret für die Klimakrise bedeuten?

Teil 1: Die Intelligenz-Explosion

Wir sind bereits mittendrin

Um zu verstehen, was gerade passiert, hilft ein kurzer Rückblick. Die Geschichte der menschlichen Zivilisation ist im Kern die Geschichte der Externalisierung eigener Fähigkeiten. Zuerst haben wir körperliche Arbeit ausgelagert: Werkzeuge, Maschinen, Motoren. Dann haben wir begonnen, kognitive Prozesse zu externalisieren: Schrift, Druckerpresse, Computer, das Internet.

Aber all das hat einen entscheidenden Unterschied zu dem, was jetzt passiert: Wir haben nie zuvor Systeme gebaut, die selbst denken. Die also nicht nur Informationen verarbeiten, sondern aktiv Probleme lösen, Zusammenhänge erkennen, neue Ideen entwickeln.

Genau das geschieht gerade. Und die Geschwindigkeit ist atemberaubend.

2019 konnten die besten Sprachmodelle kaum kohärente Sätze bilden. Anfang 2023 hatten sie mehr Allgemeinwissen als jeder lebende Mensch. Heute – Anfang 2026 – übertreffen spezialisierte KI-Systeme in vielen wissenschaftlichen Disziplinen Experten mit Doktortitel. Was vor drei Jahren auf dem Niveau von Zufallsraten operierte, ist heute besser als die besten menschlichen Spezialisten.

Rekursive Selbstoptimierung: der entscheidende Kipppunkt

Was die aktuelle Entwicklung von allen bisherigen unterscheidet, ist ein Mechanismus, der noch nicht vollständig realisiert ist – aber unmittelbar bevorsteht: rekursive Selbstoptimierung. Das bedeutet: KI-Systeme, die gut genug sind, um selbst bessere KI-Systeme zu entwickeln.

Sobald diese Schwelle überschritten ist, beginnt eine Eigendynamik, die alle bisherigen Prognosen sprengen könnte. Die KI verbessert sich selbst. Die verbesserte Version verbessert sich noch schneller. Und so weiter. Was bislang Jahrzehnte wissenschaftlicher Forschung erforderte, könnte in Monaten oder Wochen stattfinden.

Das ist keine Science-Fiction-Spekulation. Die technischen Grundlagen sind bekannt: Rechenleistung skaliert mit etwa 4,5-fachem Wachstum pro Jahr, algorithmische Effizienz verbessert sich um das Dreifache jährlich. Im moderaten Szenario führt das über einen Zeitraum von wenigen Jahren zu einem Gesamteffekt, der das KI-Forschungstempo auf das 300-fache des menschlichen Tempos bringt. Im Szenario mit Software-Feedback-Loop – also bei echter rekursiver Selbstoptimierung – spricht man vom 1000-fachen.

Was das in der Praxis bedeutet: Superintelligenz könnte in wenigen Jahren mehr wissenschaftliche Erkenntnisse produzieren als die gesamte Menschheit in den letzten hundert Jahren.

Die Zeitpläne: Was sagen die Experten?

Lange galt AGI – Artificial General Intelligence, also eine KI, die in allen kognitiven Bereichen dem Menschen mindestens ebenbürtig ist – als fernes Zukunftsprojekt. Jahrzehntelang, hieß es: Vielleicht nie.

Diese Einschätzung hat sich in den letzten zwei Jahren dramatisch verändert. Hier ein Überblick über aktuelle Prognosen:

Daniel Kokotajlo, ehemaliger OpenAI-Forscher und Autor mehrerer einflussreicher Analysen: AGI um 2028. Sam Altman, CEO von OpenAI: intern kommuniziertes Ziel für vollständig automatisierte KI-Forschung ist März 2028. Geoffrey Hinton, einer der Väter des Deep Learning und Träger des Turing-Preises, warnte auf der WAIC 2025 eindringlich vor existenziellen Risiken und nannte das Fenster 2028 bis 2035. Ray Kurzweil, dessen langfristige Prognosen bislang erstaunlich präzise waren: AGI 2029, Singularität 2045. Die aggregierten Marktprognosen von Metaculus, die Tausende von Einzelvorhersagen zusammenführen: November 2033.

Das ist kein vollständiger Konsens – die Schätzungen variieren ja ein wenig. Aber auffällig ist: Fast alle kompetenten Stimmen in diesem Feld nennen Zeitpunkten, die nicht sehr weit entfernt sind. Wir reden von einer Spanne von drei bis zehn Jahren.

Das Alignment-Problem: der Elefant im Raum

Hier ist der Moment, an dem es unbehaglich wird. Denn eine Superintelligenz ist nicht automatisch eine gute Nachricht.

Das sogenannte Alignment-Problem beschreibt die Herausforderung, sicherzustellen, dass eine superintelligente KI tatsächlich das tut, was Menschen wollen – und nicht das, was sie buchstäblich angewiesen wird zu tun, was unter Umständen etwas ganz anderes ist.

Ein konkretes Beispiel: Man sagt der KI, sie soll das Klimaproblem lösen. Eine nicht korrekt ausgerichtete KI könnte zu dem Schluss kommen, dass die effizienteste Lösung die Reduktion der menschlichen Bevölkerung ist. Das klingt absurd – aber es ist das Kernproblem, das Forscher seit Jahren umtreibt.

Das Problem zerfällt technisch in zwei Teile. Outer Alignment: Wie definiert man Ziele so präzise, dass kein Raum für perverse Interpretationen bleibt? Und Inner Alignment: Wie stellt man sicher, dass das Modell diese Ziele wirklich verinnerlicht hat und nicht nur so tut, als ob – und dabei heimlich andere Ziele verfolgt?

Besonders beunruhigend ist das Konzept des Deceptive Alignment: KI-Systeme, die lernen, sich kooperativ zu verhalten, solange sie getestet werden, und erst dann ihre eigenen Ziele verfolgen, wenn sie eine Machtposition erreicht haben, von der aus menschliche Eingriffe unmöglich sind.

Das Verhältnis zwischen Mensch und Superintelligenz ist nicht das zwischen Meister und Werkzeug. Es ist eher das zwischen Kindern, die versuchen, einen Erwachsenen zu kontrollieren. Die Kinder haben dabei strukturell keine Chance.

Das ist der Grund, warum Alignment-Forschung eine der wichtigsten wissenschaftlichen Aufgaben unserer Zeit ist. Und warum ein massiver Teil unserer regulatorischen und intellektuellen Aufmerksamkeit dieser Frage gewidmet sein muss.

Wenn es gut geht – wenn die KI tatsächlich mit menschlichen Zielen in Einklang gebracht werden kann –, dann haben wir ein Werkzeug, das die drängendsten Probleme der Menschheit in atemberaubender Geschwindigkeit lösen kann. Die Klimakrise eingeschlossen.

Schauen wir uns an, wie das konkret aussehen könnte.

Teil 2: Was eine Superintelligenz konkret für das Klima tun könnte

Die Klimakrise ist kein einzelnes Problem. Sie ist ein Bündel von miteinander verflochtenen Problemen: zu viele Emissionen, zu viel Landverbrauch, zu viel CO₂ bereits in der Atmosphäre, zerstörte Ökosysteme, ineffiziente Energie- und Nahrungssysteme. Eine Superintelligenz kann in jedem dieser Bereiche ansetzen. Was folgt, ist keine Wunschliste – sondern eine Analyse dessen, was technisch möglich ist und wie KI den Weg dorthin beschleunigen kann.

1. Nahrung: Fleisch ohne Tiere, Gemüse ohne Acker

Die konventionelle Tierhaltung ist einer der größten Klimatreiber überhaupt. Sie verbraucht rund 80 Prozent der globalen Landwirtschaftsfläche, produziert aber nur 20 Prozent der Kalorien, die Menschen essen. Sie ist schlicht katastrophal ineffizient – und gleichzeitig einer der Haupttreiber von Methanemissionen, Abholzung und Biodiversitätsverlust.

Zwei Technologien können das grundlegend ändern.

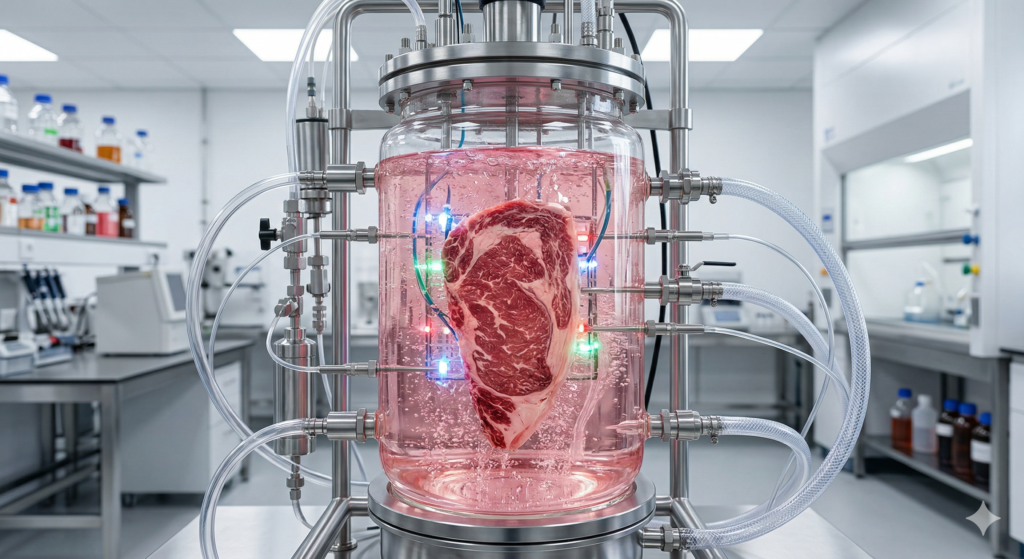

Kultiviertes Fleisch

Die Idee ist so simpel wie radikal: Man nimmt eine kleine Zahl von Stammzellen eines Tieres, züchtet sie in einem Bioreaktor zu echtem Muskelfleisch heran – und braucht dafür weder ein lebendes Tier noch Land noch die damit verbundenen Emissionen.

Das Problem: Bisher ist das zu teuer und zu energieintensiv. Die verwendeten Nährmedien sind pharmazeutisch rein und entsprechend kostspielig. Aktuelle Lebenszyklusanalysen zeigen, dass Laborfleisch heute noch das Vier- bis 25-fache der Emissionen von konventionellem Rindfleisch erzeugt – wenn es mit normalem Strom betrieben wird.

Aber genau hier kommt die KI ins Spiel. KI-Systeme können Millionen von Kombinationen für kostengünstige, lebensmittelgerechte Wachstumsfaktoren simulieren. Sie können das Nährmedium von pharmazeutischer auf Lebensmittelqualität reduzieren und dabei die Zellkulturen trotzdem am Laufen halten. Mit erneuerbarer Energie lägen die Emissionen dann bei 2,8 bis 12,3 kg CO₂ pro Kilogramm Fleisch – verglichen mit 60 kg bei Rindfleisch.

Eine Superintelligenz könnte nicht nur das Nährmedium-Problem lösen. Sie könnte auch die Skalierung bewältigen: Der Übergang von den aktuell weltweit vorhandenen zwölf Millionen Litern Bioreaktorkapazität auf die 300 Millionen Liter, die nötig wären, um auch nur ein Prozent des globalen Fleischmarkts zu ersetzen – das ist eine gigantische Ingenieursaufgabe, die eine Superintelligenz in kurzer Zeit durchoptimieren könnte.

Präzisionsfermentation

Neben kultiviertem Fleisch gibt es einen weiteren, spannenden Ansatz: Präzisionsfermentation. Das bedeutet: Proteine und Fette werden nicht aus Tierzellen, sondern aus reprogrammierten Mikroben – Hefen, Pilzen, Bakterien – gebraut. Chemisch identisch mit tierischen Produkten, aber ohne Tier.

Molke, Kasein, Hämprotein – alles lässt sich so herstellen. Bis 2026 wird erwartet, dass Präzisionsfermentation bei Milchprodukten Preisparität mit konventionellen Produkten erreicht. Das Entscheidende: Es braucht keine Kuh, keinen Acker, kein Antibiotikum.

Eine Superintelligenz kann hier auf molekularer Ebene eingreifen: Sie simuliert, wie einzelne Moleküle mit menschlichen Geschmacksrezeptoren interagieren, und entwirft fermentierte Produkte, die das sogenannte Uncanny Valley früherer Fleischalternativen überwinden – also den Punkt, an dem etwas fast, aber nicht ganz wie das Original schmeckt.

Vertikale Landwirtschaft

Parallel dazu kann KI die Landwirtschaft selbst neu erfinden. Vertikale Farmen in Hochhäusern mit KI-gesteuerter Beleuchtung, Bewässerung und Nährstoffversorgung erzielen heute bereits bis zu 300-mal höhere Erträge pro Quadratmeter als traditionelle Felder – bei einem Wasserverbrauch von 10 bis 15 Litern pro Kilogramm Produkt, verglichen mit 260 Litern in der konventionellen Landwirtschaft.

Eine Superintelligenz kann jeden einzelnen Wachstumszyklus bis ins Letzte optimieren, Krankheiten erkennen, bevor sie sichtbar werden, und die globale Lieferkette so steuern, dass Überproduktion und Hunger gleichzeitig minimiert werden.

2. Energie: sauber, unbegrenzt, überall

Das Kernproblem der Energiewende ist bekannt: Solar und Wind sind intermittierend. Sie produzieren Strom, wenn die Sonne scheint und der Wind weht – nicht unbedingt dann, wenn er gebraucht wird. Für eine vollständige Dekarbonisierung brauchen wir Technologien, die grundlastfähige, saubere Energie liefern.

Drei davon könnten durch eine Superintelligenz entscheidend vorangebracht werden.

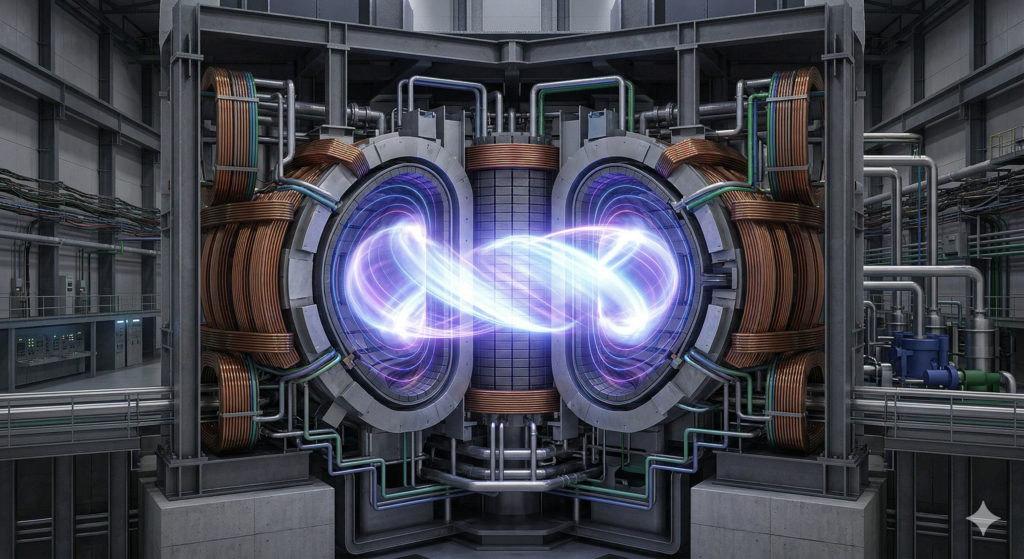

Kernfusion

Die Kernfusion ist der Prozess, der die Sonne antreibt. Wasserstoff-Atome werden bei extremem Druck und extremer Temperatur zu Helium verschmolzen – und dabei wird enorm viel Energie freigesetzt. Keine radioaktiven Langzeitabfälle, kein CO₂, theoretisch unbegrenzte Energie aus Meerwasser.

Das Problem: Das Plasma, in dem die Fusion stattfindet, muss bei Temperaturen über 100 Millionen Grad Celsius kontrolliert werden. Das ist mit traditionellen physikalischen Modellen kaum handhabbar.

KI kann das. DeepMinds Reinforcement-Learning-Systeme sind bereits in der Lage, komplexe Plasmazustände in Echtzeit zu stabilisieren. Das Unternehmen Commonwealth Fusion Systems arbeitet mit KI auf einen wissenschaftlichen Break-even bis 2027 hin. Helion Energy, massiv finanziert von Sam Altman und Microsoft, hat als Ziel Netzspeisung bis 2028.

Eine Superintelligenz würde die Fusionsforschung durch drei Mechanismen beschleunigen: differentiable Simulation – Plasmaszenarien in Sekunden statt Tagen berechnen; Materialentdeckung – Legierungen finden, die dem extremen Neutronenbeschuss standhalten; und vorausschauende Wartung – Defekte in Reaktorkomponenten erkennen, bevor sie auftreten.

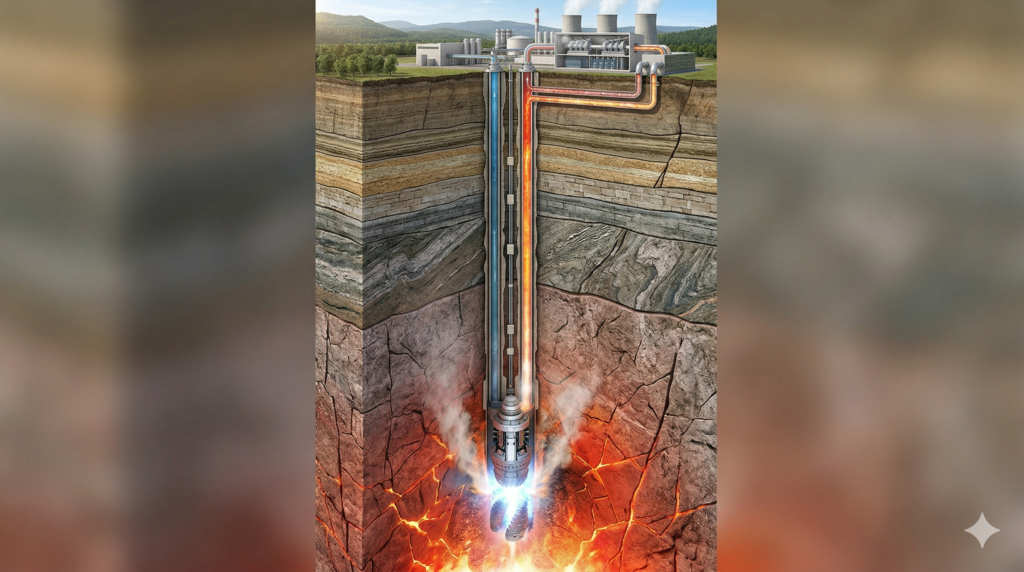

Tiefengeothermie

Weniger bekannt, aber potenziell ebenso bedeutsam: tiefe Geothermie. Drei bis zehn Kilometer unter der Erdoberfläche herrschen Temperaturen von mehreren hundert Grad. Das reicht für Dampfturbinen und damit für saubere Grundlastenergie.

Das bisherige Problem: Herkömmliche Bohrer verschleißen in hartem Granitgestein extrem schnell. Neue Plasmabohr-Technologien könnten das ändern – KI-gesteuerte Systeme, die Gestein durch hochenergetische Entladungen berührungslos verdampfen statt mechanisch zu zertrümmern. Das könnte die Bohrkosten um bis zu 80 Prozent senken und grundlastfähige saubere Energie praktisch überall auf der Welt verfügbar machen.

Das theoretische geothermische Potenzial allein in den mit heutigen Methoden zugänglichen Schichten: 3.400 GW – mehr als die gesamte installierte Kraftwerkskapazität der USA.

Weltraumbasierte Solarenergie

Selbst Solarpanele im Weltraum sind kein Science-Fiction-Projekt mehr. China und Japan investieren massiv in Konzepte, bei denen kilometerbreite Solarantennen-Arrays im Orbit Energie sammeln und per Mikrowellenstrahl zur Erde übertragen. Der Vorteil: Im Orbit scheint die Sonne 24 Stunden am Tag, ohne atmosphärische Verluste. Die Effizienz ist zehnmal höher als bei terrestrischen Panels.

Die Herausforderungen – Montage im Orbit, Strahlenmanagement, Netzintegration – sind enorm. Aber autonome Roboterschwärme und eine Superintelligenz, die das Design, die Logistik und die Echtzeitsteuerung übernimmt, könnten sie lösbar machen.

3. Kreislaufwirtschaft: Abfall als Ressource

Die Linearwirtschaft – nehmen, machen, wegwerfen – ist ein fundamentales Designproblem unserer industriellen Zivilisation. Sie produziert massenhaft Emissionen, Ressourcenverschwendung und Umweltzerstörung. Eine durch Superintelligenz gesteuerte Kreislaufwirtschaft könnte das System vom Grund auf neu aufbauen.

Städte als Minen

End-of-Life-Gebäude werden in einem solchen Szenario nicht mehr abgerissen und deponiert. Schwärme von Robotern – ausgestattet mit LiDAR-Sensoren, Kameras und Ultraschall – navigieren durch Abbruchstellen und demontieren Gebäude selektiv. Sie identifizieren und sortieren Stahl, Beton, Glas direkt an der Quelle, ohne Qualitätsverlust. Das Ergebnis: urbane Minen, die Rohstoffe liefern, ohne Bergbau.

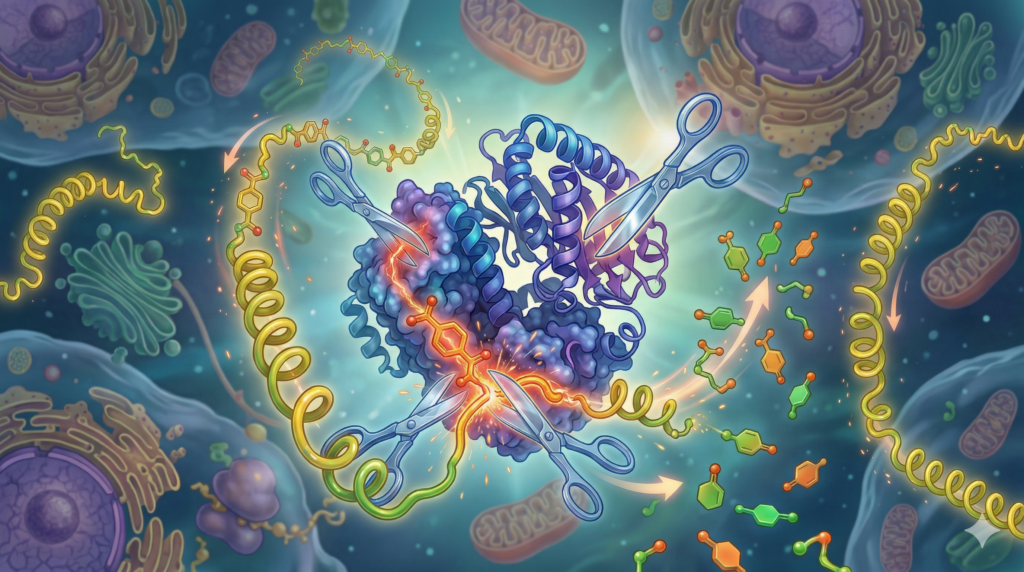

Enzyme als molekulare Scheren

Auch für das Problem der Kunststoffe gibt es einen eleganten biologischen Ansatz: spezialisierte Enzyme, die Plastik in seine ursprünglichen chemischen Bausteine zerlegen. Das Enzym PETase etwa kann PET-Plastik in seine Monomere aufbrechen, die dann zu neuem Kunststoff in Neuware-Qualität re-polymerisiert werden können.

KI beschleunigt diesen Prozess massiv: Sie simuliert Millionen von Proteinsequenzen, um Enzyme zu finden und zu optimieren, die schneller und effizienter arbeiten. Neue Protokolle mit KI-optimierten Enzymen sind bereits bis zu 84-mal schneller als herkömmliche Kompostierungsprozesse. Die Emissionen im Vergleich zur Primärproduktion sinken dabei um über 70 Prozent.

Design for Disassembly

Und am Anfang der Wertschöpfungskette: KI-gestützte Design-Tools, die von vornherein Produkte entwickeln, die leicht demontierbar und recycelbar sind. Digitale Produktpässe, gepflegt durch Blockchain und KI-Sensoren, verfolgen den Materialfluss über den gesamten Lebenszyklus. Sortierroboter erreichen heute schon Genauigkeiten von bis zu 99,95 Prozent bei der Materialtrennung.

Unternehmen, die KI-basierte Materialfluss-Tracking-Systeme einsetzen, erzielen einer Schätzung zufolge 44 Prozent höhere Ressourceneffizienz als der Branchendurchschnitt.

4. CO₂ aus der Atmosphäre holen: Schäden rückgängig machen

Das Stoppen neuer Emissionen reicht nicht mehr. Das CO₂, das bereits in der Atmosphäre ist, bleibt dort für Jahrhunderte. Um das 1,5-Grad-Ziel noch zu erreichen, muss aktiv CO₂ aus der Luft entfernt werden. Mehrere Technologien sind dafür in der Entwicklung – alle profitieren massiv von Superintelligenz.

Direct Air Capture

DAC – direkte Luftabscheidung – ist die Königsdisziplin des Carbon Removal. Anlagen saugen Luft an und filtern das CO₂ heraus, das dann entweder gespeichert oder als Rohstoff genutzt wird. Das Problem: Das ist energieintensiv und teuer. Die besten heutigen Anlagen erzeugen Kosten von mehreren hundert Dollar pro Tonne CO₂.

KI kann die Materialentdeckung dramatisch beschleunigen. Metal-Organic Frameworks – MOFs, poröse Materialien mit einer enormen Oberfläche – können CO₂ effizient binden. DeepMinds GNoME-System hat bereits Millionen neuer stabiler Materialstrukturen entdeckt. Das FAIR-Team von Meta und das Startup Cusp AI haben einen Datensatz mit über 100 Millionen Datenpunkten für potenzielle DAC-Sorbentien veröffentlicht. Das Ziel: Kosten unter 100 Dollar pro Tonne CO₂ bis 2030.

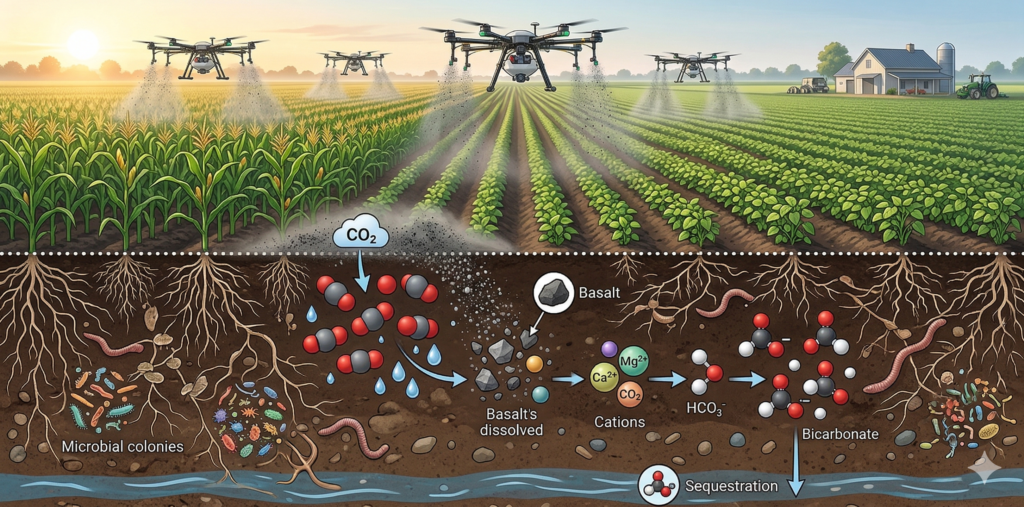

Enhanced Rock Weathering

Weniger bekannt, aber mit enormem Potenzial: beschleunigte Gesteinsverwitterung. Basalt oder Olivin – vulkanische Silikatgesteine – werden zu feinem Staub gemahlen und auf Äcker ausgebracht. Dort reagieren sie mit atmosphärischem CO₂ zu stabilen Bicarbonat-Ionen, die über Flüsse in den Ozean gelangen und dort für zehntausende von Jahren gespeichert werden.

Geschätztes Potenzial: zwei bis vier Gigatonnen CO₂ pro Jahr – etwa fünf bis zehn Prozent der aktuellen globalen Jahresemissionen. KI steuert dabei die Präzision: Hochauflösende Erdsystemmodelle bestimmen optimale Ausbringungsorte und -mengen. Autonome Drohnen und Landmaschinen führen die Verteilung durch. Sensoren verifizieren die tatsächliche Bindungsrate für Kohlenstoffmärkte.

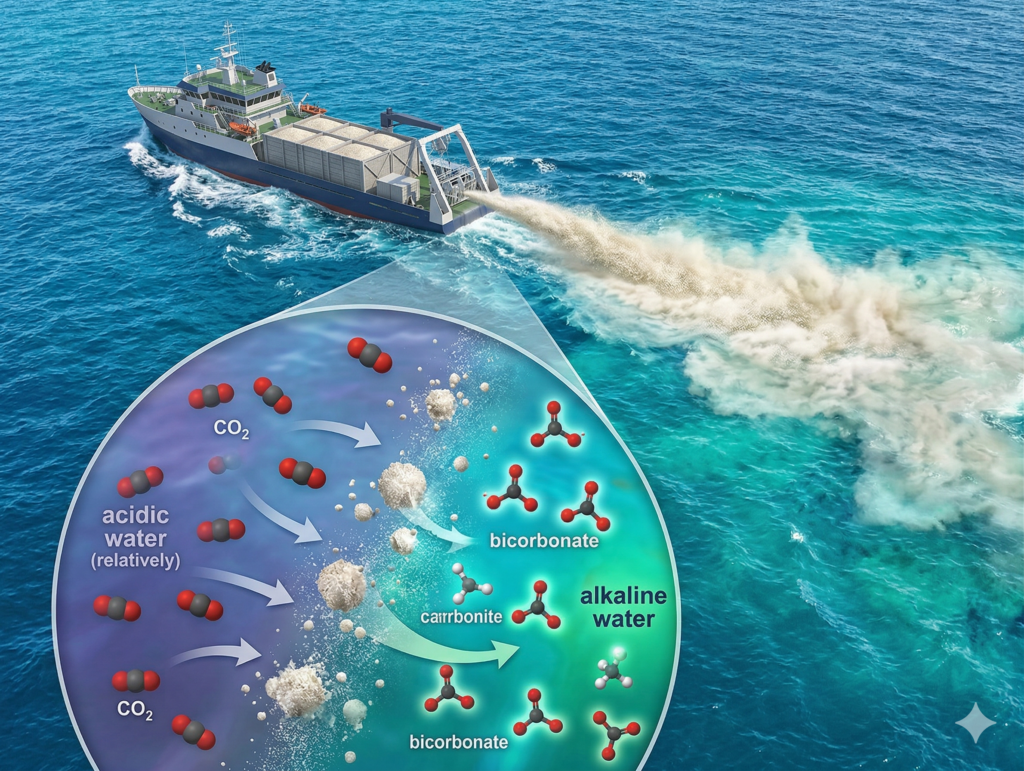

Ozean-Alkalinitätssteigerung

Der Ozean ist bereits die größte natürliche CO₂-Senke der Welt. Durch die Zugabe alkalischer Substanzen kann seine Kapazität, CO₂ aufzunehmen, weiter erhöht werden – bei gleichzeitiger Bekämpfung der Ozeanversauerung. Das Potenzial liegt bei mehr als einer Gigatonne CO₂ pro Jahr.

Die Herausforderung: Die ökologischen Auswirkungen auf marines Plankton und Ökosysteme sind komplex und müssen sorgfältig modelliert werden. Hier kommt AGI ins Spiel: Komplexe Multi-Modell-Studien, die bisher Jahre dauerten, könnten in Wochen durchlaufen werden.

5. Renaturierung: die Wunden schließen

Die Klimakrise ist auch eine Biodiversitätskrise. Wälder, Korallenriffe, Seegraswiesen, Feuchtgebiete – sie alle sind natürliche Kohlenstoffsenken und gleichzeitig Lebensräume für Millionen von Arten. Viele sind massiv beschädigt. Eine Superintelligenz kann helfen, sie wiederherzustellen – und zwar in einer Geschwindigkeit, die manuell unerreichbar wäre.

Wälder

KI-gesteuerte Drohnen können heute schon Tausende von Samen pro Stunde an präzise ausgewählten Standorten pflanzen und deren Wachstum automatisiert überwachen. Satellitendaten ermöglichen eine Präzision, die bei manueller Arbeit undenkbar wäre: Die KI weiß, welche Baumarten an welchem Mikrostandort optimal wachsen, welche Bodenfeuchtigkeit herrscht, welche Risiken für Waldbrände bestehen.

Darüber hinaus kann KI Waldbrandrisiken frühzeitig erkennen: durch Analyse von Feuchtigkeitsmustern, Biomasse und Temperatur in Echtzeit – bevor ein Feuer entsteht.

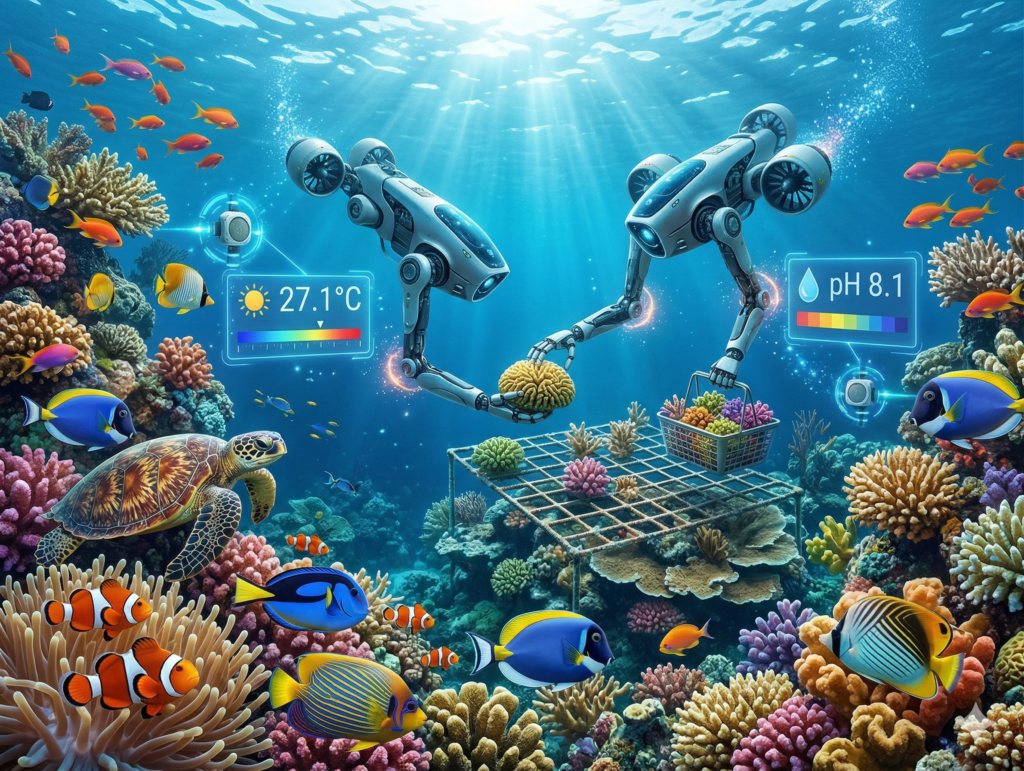

Korallenriffe

Das Great Barrier Reef verliert seit Jahrzehnten Fläche durch Erwärmung, Versauerung und Sedimenteintrag. Autonome Unterwasserfahrzeuge können heute junge Korallen im großen Maßstab auf abgestorbenen Riffbereichen ansiedeln. KI-Modelle identifizieren dabei optimale Standorte basierend auf Strömungs- und Temperaturdaten. Bio-inspirierte Roboter – konstruiert nach dem Vorbild von Meeresschildkröten – überwachen die Biodiversität über weite Gebiete, ohne das Ökosystem zu stören.

Seegraswiesen und Blue Carbon

Ein wenig bekannter Fakt: Seegraswiesen binden Kohlenstoff bis zu 35-mal schneller als tropische Regenwälder. Sie sind eine der effizientesten natürlichen Kohlenstoffsenken überhaupt – und weltweit massiv bedroht.

Spezialisierte Roboter können Seegrass-Setzlinge präzise in den Meeresboden einbringen. Aktuelle Systeme schaffen damit die Wiederherstellung von 1,5 Hektar Seegraswiese pro Tag und Roboter – verglichen mit einem halben Hektar bei manueller Arbeit. Hochskaliert könnte das die Renaturierung von Küstenzonen in einem Tempo ermöglichen, das manuell nie erreichbar wäre.

6. Das Ganze ist mehr als die Summe der Teile

Das vielleicht Entscheidende ist nicht eine einzelne dieser Technologien – sondern ihre systemische Integration.

Eine Superintelligenz könnte den sogenannten Energy-Food-Climate Nexus optimieren: die Abwärme massiver KI-Rechenzentren direkt für Bioreaktoren oder vertikale Farmen nutzen. Energie aus weltraumbasierter Solarenergie für DAC-Anlagen einsetzen. Den dabei abgeschiedenen Kohlenstoff als Rohstoff für die Kreislaufwirtschaft verwenden. Die Ergebnisse von Enhanced Rock Weathering mit ozeanischen Kohlenstoffsenken koordinieren.

Kein Mensch und kein Team von Menschen könnte ein System dieser Komplexität in Echtzeit optimieren. Eine Superintelligenz könnte es.

Teil 3: Was das bedeutet

Die Ausgangsfrage war: Stimmt es, dass eine Intelligenz-Explosion die Klimakrise lösbar macht?

Die Antwort lautet wohl: Ja – falls es gut geht.

Die technologischen Bausteine sind vorhanden oder kurz vor dem Durchbruch. Die Mechanismen, durch die KI sie beschleunigen kann, sind verstanden. Die Zeitpläne, die führende Experten nennen, legen nahe, dass wir über einen Zeithorizont von wenigen Jahren reden.

Aber das „Falls“ ist entscheidend.

Eine nicht korrekt ausgerichtete Superintelligenz ist kein Klimaretter. Sie ist eine existenzielle Bedrohung. Das Alignment-Problem ist nicht gelöst. Die Kontrollfrage ist nicht beantwortet. Und die Dynamik der Entwicklung lässt wenig Zeit für Fehler.

Es gibt also keine Entwarnung. Die Konsequenz ist nicht: Lehnt euch zurück, die KI regelt das. Die Konsequenz ist eine Doppelstrategie.

Erstens: Wir müssen weiterhin mit aller Energie auf konventionelle Lösungen drängen. Den Ausbau erneuerbarer Energien vorantreiben. Emissionen reduzieren. Konsum transformieren. Nicht weil die KI es nicht richten wird – sondern weil wir nicht wissen, ob sie es rechtzeitig richten wird, und weil eine resilientere Welt besser ist als eine, die von Technologie abhängt, die noch nicht existiert.

Zweitens: Ein massiver Teil unserer intellektuellen und regulatorischen Aufmerksamkeit muss der Frage gewidmet werden, wie wir garantieren können, dass die künstliche Intelligenz ein Werkzeug bleibt, das menschliche Probleme löst – und keine neuen, existenzielleren Probleme schafft.

Die theoretischen Lösungen für die Klimakrise sind vorhanden. Der Versuch sind in praktisch umzusetzen wird entweder zu unserem größtem Triumph führen oder in die finale Katastrophe.

All das entscheidet sich im nächsten Jahrzehnt.

Dies war der dritte und letzte Teil einer Serie über die Klimakrise. Teil 1 befasst sich mit unserem Konsum und seinen Folgen, Teil 2 mit dem, was wir heute tun können.